Transcendence: Künstliche Intelligenz, reale Gefahr?

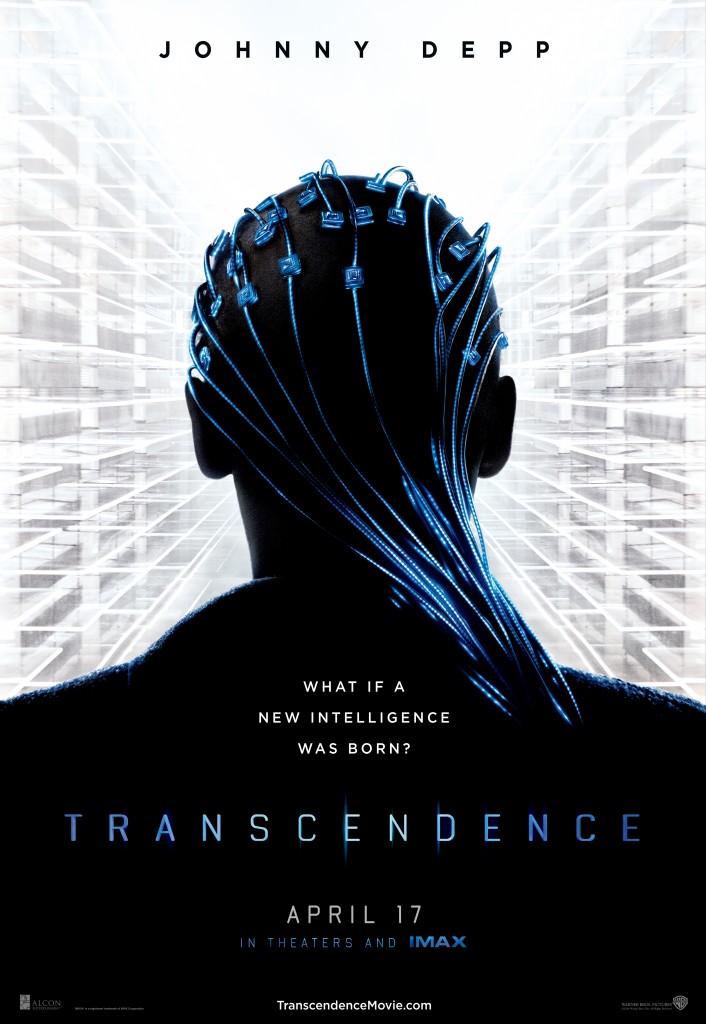

Der Hollywood-Blockbuster “Transcendence” ist neu in den Kinos. Ohne zu viel von der Handlung zu verraten: Im Film ist der künstliche Intelligenz-Forscher Dr. Caster (gespielt von Johnny Depp) dabei, eine superintelligente Maschine zu erschaffen, doch technologiefeindliche Extremisten versuchen, dies mit allen Mitteln zu verhindern.

Natürlich ist der Film – wie die meisten Hollywood Blockbuster – aus wissenschaftlicher Sicht nicht wirklich ernst zu nehmen. Aber das Kind mit dem Badewasser auszuschütten und die reine Möglichkeit superintelligenter Maschinen als blosse Science Fiction abzutun, wäre ein Fehler. In ihrem Artikel “Transcending Complacency on Superintelligent Machines” bezeichnen der MIT-Professor Max Tegmark, der Informatik-Professor Stuart Russell, der theoretische Physiker Stephen Hawking, sowie der Nobelpreisträger Frank Wilczek diese bequeme Haltung sogar als “möglicherweise den schwerwiegendsten Fehler aller Zeiten.”

Forschung in künstlicher Intelligenz (KI) hat in letzter Zeit bahnbrechende Fortschritte erzielt. Doch selbstfahrende Autos, das Computerprogramm Watson und die Spracherkennungssoftware Siri sind erst der Anfang. Die KI-Forschung verfügt mit jedem Jahr über mehr Geld, mehr WissenschaftlerInnen und mehr theoretische Grundlagen. Vermutlich werden die heutigen Erfindungen im Vergleich mit den technologischen Errungenschaften der nächsten Jahrzehnte bescheiden anmuten.

Die möglichen Vorteile von KI sind enorm: Wir Menschen verdanken unsere Vormachtstellung auf der Erde nicht unserer Muskelstärke oder Schnelligkeit, sondern dem einzigartigen Einfallsreichtum unseres Gehirns. Vor allem aufgrund unserer Intelligenz konnten wir jene politischen, wirtschaftlichen, technologischen und wissenschaftlichen Errungenschaften anhäufen, von denen unsere moderne Zivilisation abhängt. Wir können uns gar nicht ausmalen, was wir mit superintelligenter KI erreichen könnten, aber die Beseitigung von Kriegen, Krankheit und Armut scheint hierdurch in Reichweite zu gelangen. Die Erschaffung einer superintelligenten Maschine wäre wahrscheinlich das bedeutendste Ereignis in der Geschichte der Menschheit.

Bedauerlicherweise könnte es diese auch frühzeitig beenden, wenn wir nicht lernen, die damit verbundenen Gefahren zu vermeiden. Schon heute erwägen einige Militärmächte autonome Waffensysteme zu entwickeln, die ihre Ziele selbstständig auswählen und eliminieren können. Menschenrechtsorganisationen wie die UNO und Human Rights Watch haben sich bereits für Abkommen ausgesprochen, die solche Waffensysteme verbieten.

Im letzten Jahrzehnt hat sich die KI-Forschung zudem immer mehr in Richtung AGI (artificial general intelligence) entwickelt, ein Feld das lange Zeit unterfinanziert und auf vereinzelte Forscher abseits des Mainstreams beschränkt war. Doch die Zeiten ändern sich: So hat beispielsweise Google Anfang dieses Jahres die KI-Firma DeepMind für ca. 400 Millionen Dollar gekauft, deren erklärtes Ziel es ist, universal anwendbare Lernalgorithmen zu konstruieren. Beachtenswert ist, dass Shane Legg, ein Mitgründer von DeepMind, auf die Einrichtung eines Ethikrats bestanden hat, um mögliche Risiken von KI zu minimieren. Und die Risiken sind hoch: Legg zufolge ist “KI die Nummer 1” unter allen Technologien, welche die Menschheit potentiell auslöschen könnten.

Innerhalb dieses Jahrhunderts – oder vielleicht sogar schon innerhalb der nächsten Jahrzehnte – könnten sich also Szenarien von riesiger Tragweite abspielen. Im Gegensatz zur Lichtgeschwindigkeit oder der Elektronenmasse ist die Intelligenz keine Naturkonstante. Kein physikalisches Gesetz verbietet es, Maschinen herzustellen, die Informationen noch effizienter verarbeiten als menschliche Gehirne und somit unsere Intelligenz übertreffen. Möglicherweise ereignet sich sogar eine explosionsartige Transformation, obwohl sie vermutlich anders ablaufen wird, als im Film dargestellt: Der Statistiker Irving Good hat bereits im Jahre 1965 bemerkt, dass eine superintelligente Maschine ihre Funktionsweise und folglich ihre Intelligenz wiederholt verbessern und ein Ereignis einleiten könnte, das im Film als “Transzendenz” bezeichnet und das gemeinhin “Intelligenzexplosion” oder (technologische) „Singularität“ genannt wird.

Doch was genau ist damit gemeint? Neben der “Intelligenzexplosion” werden häufig noch zwei weitere Auslegungen des Begriffs “Singularität” verwendet: Zum einen im Sinne eines epistemischen Ereignishorizonts: Mit unserer bloss menschlichen Intelligenz können wir schlichtweg nicht vorhersagen, welche Folgen die Erschaffung superintelligenter Maschinen nach sich zieht, oder zu welchen Taten diese in der Lage sind1. Die “Accelerating Change”-These hingegen behauptet, dass unsere technologischen Errungenschaften (wie z.B. die Anzahl der Transistoren auf einem Computerchip) einem exponentiellen Wachstum unterliegen, was eines Tages in eine “Singularität” münden wird. Wie die Weizenkornlegende anschaulich darlegt, wird die Geschwindigkeit exponentiellen Wachstums von der menschlichen Intuition massiv unterschätzt. Dies könnte unter anderem unsere gleichmütige Einstellung gegenüber der Entwicklung von KI erklären.

Egal, welcher der drei Interpretationen man nun folgt, sie scheinen in einem Punkt übereinzustimmen: Die Möglichkeiten einer superintelligenten KI übersteigen unsere kühnsten Träume – und Alpträume. Es wäre folglich naiv, a priori auzuschliessen, dass eine solche KI nicht dazu fähig wäre, die Finanzmärkte zu überlisten, PolitikerInnen zu manipulieren, sowie Technologien und Waffensysteme zu entwickeln, die für uns genauso unverständlich sind, wie Flugzeuge und lasergelenkte Waffen es für Schimpansen sind. Kurzfristig betrachtet beruhen die Auswirkungen von KI also vor allem darauf, von wem sie kontrolliert wird. Doch die langfristigen Auswirkungen von KI hängen davon ab, ob sie überhaupt kontrolliert werden kann.

Zudem können wir uns nicht darauf verlassen, dass eine superintelligente Maschine automatisch “super-wohlwollend” ist. Allgemein gesprochen können wir nicht davon ausgehen, dass eine KI menschliche Emotionen und Ziele wie “Mitleid”, “Gerechtigkeitssinn” oder “Streben nach Autonomie” besitzen wird – dies wäre kritikloser Anthropomorphismus, der zwar äusserst intuitiv, aber häufig genauso irreführend ist, wie beispielsweise der Animismus zeigt. Der Oxford-Philosoph Nick Bostrom geht sogar noch weiter und argumentiert, dass Ziele und Intelligenz “orthogonal” zueinander stehen, d.h. dass eine superintelligente Maschine beliebige, ja sogar “schlechte” Ziele haben kann – jedenfalls aus menschlicher Sicht. Es kommt also darauf an, die KI mit dem “richtigen” Zielsystem auszustatten. Es ist eine offene Forschungsfrage, wie genau dies zu bewerkstelligen ist.

Wir sehen uns also mit gewaltigen Vorteilen, aber auch mit immensen Risiken konfrontiert. Aber nur die Ruhe, denn die Experten unternehmen bereits alles Menschenmögliche, um den besten Ausgang zu gewährleisten, nicht wahr? Falsch. Angenommen, ein Asteroid würde nach den Berechnungen der Forscher mit einer nicht zu vernachlässigenden Wahrscheinlichkeit innerhalb der nächsten Jahrzehnte mit der Erde kollidieren. Würden wir dann einfach achselzuckend erwidern: “Wird schon gut gehen”? Wohl kaum.

Aber diese Situation ist vergleichbar mit dem, was gerade in Bezug auf KI passiert. Obwohl wir dem möglicherweise bedeutsamsten Ereignis der menschlichen Geschichte entgegensehen, wird diesen Themen nur wenig ernsthafte Forschung gewidmet. Die löbliche Ausnahme bilden einige Organisationen wie das Cambridge Center for Existential Risk, das Future of Humanity Institute, das Machine Intelligence Research Institute, das Foundational Research Institute und das Future of Life Institute.

Es steht also einiges, vielleicht geradezu alles auf dem Spiel. Jeder von uns – nicht nur WissenschaftlerInnen oder PolitikerInnen – sollte sich die Frage stellen, was wir heute tun können, um die Wahrscheinlichkeit einer günstigen Entwicklung zu erhöhen.

Fussnote

1. Wobei hier anzumerken ist, dass fast alle KIs, die ein gewisses Intelligenzniveau überschreiten, grundlegende instrumentelle Ziele wie beispielsweise “Selbsterhaltung” und “Selbstverbesserung” gemeinsam haben. Somit können wir zumindest grobe Vorhersagen bezüglich der Handlungsweise superintelligenter Maschinen treffen.