Sind deontologische moralische Urteile lediglich Rationalisierungen?

- Utilitaristische und deontologische Prozesse

- Kognition und Emotion

- Emotionen und deontologische Urteile

- Ist der Utilitarismus emotionslos? ‒ Im Gegenteil!

- Quellenangabe

In einem früheren Beitrag konnten wir bereits sehen, dass Menschen zu widersprüchlichen moralischen Entscheidungen neigen, jeweils abhängig davon, mit welchem Dilemma sie konfrontiert werden. Der Moralphilosoph Joshua Greene behauptet sogar, dass regelbasierte deontologische Urteile tendenziell Rationalisierungen sind. Doch lässt sich diese Aussage durch wissenschaftliche Erkenntnisse stützen?

Utilitaristische und deontologische Prozesse

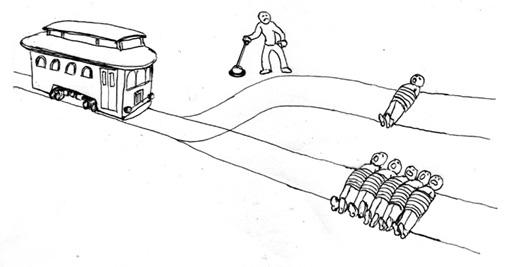

Eine Strassenbahn ist ausser Kontrolle geraten und droht, fünf an das Gleis gefesselte Personen zu überrollen. Aber du kannst sie retten, indem du eine Weiche umstellst, so dass die Strassenbahn auf ein Nebengleis umgeleitet wird, wo sie nur eine Person töten wird. Würdest du die Weiche umstellen? Die meisten Leute, die zum Weichendilemma befragt werden, sind der Meinung, dass es moralisch richtig ist, die Strassenbahn umzuleiten1 2. Sie entscheiden sich damit utilitaristisch: Sie halten es für gerechtfertigt (und/oder geboten), jemanden zu schädigen, um dadurch mehr anderen zu helfen, d.h. insgesamt mehr Gutes zu bewirken.  Betrachten wir nun eine andere Variante dieses Gedankenexperiments, das Brückendilemma. Wieder rast eine Strassenbahn auf fünf an das Gleis gefesselte Personen zu. Die einzige Möglichkeit, sie zu retten, besteht darin, einen dicken Mann von einer Brücke auf das Gleis zu stossen, was die Strassenbahn aufhält. Würdest du den Mann herunterstossen? In diesem Fall sagen die meisten Leute, es sei falsch, das Leben von fünf Personen höher zu gewichten als dasjenige einer Person. Sie entscheiden sich damit deontologisch: Sie halten die deontologische Verpflichtung zur Wahrung individueller Rechte für wichtiger als die utilitaristische Überlegung, möglichst viel Gutes zu bewirken.

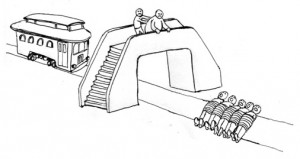

Betrachten wir nun eine andere Variante dieses Gedankenexperiments, das Brückendilemma. Wieder rast eine Strassenbahn auf fünf an das Gleis gefesselte Personen zu. Die einzige Möglichkeit, sie zu retten, besteht darin, einen dicken Mann von einer Brücke auf das Gleis zu stossen, was die Strassenbahn aufhält. Würdest du den Mann herunterstossen? In diesem Fall sagen die meisten Leute, es sei falsch, das Leben von fünf Personen höher zu gewichten als dasjenige einer Person. Sie entscheiden sich damit deontologisch: Sie halten die deontologische Verpflichtung zur Wahrung individueller Rechte für wichtiger als die utilitaristische Überlegung, möglichst viel Gutes zu bewirken.  ForscherInnen präsentierten ProbandInnen eine Vielzahl „unpersönlicher“ (wie das Weichen-Dilemma) und „persönlicher“ Dilemmas (wie das Brücken-Dilemma) dieser Art. Anhand bildgebender Verfahren stellte sich heraus, dass persönliche Dilemmas hauptsächlich Gehirnareale aktivieren, welche in Verbindung mit Emotionen stehen, während unpersönliche Dilemmas mit Aktivität im Arbeitsgedächtnis und in den für kognitive Kontrolle zuständigen Hirnbereichen assoziiert sind3.

ForscherInnen präsentierten ProbandInnen eine Vielzahl „unpersönlicher“ (wie das Weichen-Dilemma) und „persönlicher“ Dilemmas (wie das Brücken-Dilemma) dieser Art. Anhand bildgebender Verfahren stellte sich heraus, dass persönliche Dilemmas hauptsächlich Gehirnareale aktivieren, welche in Verbindung mit Emotionen stehen, während unpersönliche Dilemmas mit Aktivität im Arbeitsgedächtnis und in den für kognitive Kontrolle zuständigen Hirnbereichen assoziiert sind3.

Dies führte zur so genannten Dual-Process-Theorie moralischer Urteile, der zufolge das Brückendilemma einen Konflikt zwischen emotionaler Intuition (“Du darfst Menschen nicht von Brücken stossen!”) und utilitaristischer Kalkulation (“Das Herunterstossen der Person führt zu den wenigsten Toten”) hervorruft. Beim Brücken-Dilemma setzt sich bei den meisten Menschen die emotionale Intuition durch.

Betrachten wir nun das Baby-Dilemma: Es ist Kriegszeit. Du versteckst dich mit deinen NachbarInnen in einem Keller vor feindlichen SoldatInnen. Plötzlich fängt dein Baby zu weinen an und und du hältst seinen Mund zu, um den Lärm zu unterdrücken. Entfernst du deine Hand vom Mund des Babys, werden die SoldatInnen euch finden und töten. Entscheidest du dich dafür, das Schreien deines Babys weiterhin zu unterdrücken, wird es ersticken und sterben. Ist es moralisch vertretbar, dein Baby zu Tode zu ersticken, um dich und die anderen DorfbewohnerInnen zu retten?

In diesem Fall benötigen die Befragten mehr Zeit für eine Antwort und es lässt sich in ihren Antworten auch kein Konsens finden. Wenn die Dual-Process-Theorie recht hat, dann müssten Menschen angesichts des Baby-Dilemmas sowohl im ACC (eine mit Antwortkonflikten assoziierte Hirnregion) als auch in für die kognitive Kontrolle zuständigen Bereichen (deren Aktivität die Aufhebung einer stark emotionalen Antwort durch eine utilitaristische Überlegung nahelegt) eine erhöhte Aktivität aufweisen. Ferner müssten ProbandInnen, welche sich schliesslich für eine utilitaristische Antwort entscheiden („Rette möglichst viele Leben“) im Vergleich zu denjenigen, welche die deontologische Antwort wählen („Du darfst keine Babies töten“), mehr Aktivität in jenen Regionen des Gehirns aufzeigen, die mit dem Arbeitsgedächtnis und der kognitiven Kontrolle in Verbindung stehen. Tatsächlich konnten alle drei Vorhersagen bestätigt werden4.

Weiter befürworten PatientInnen mit zwei verschiedenen Arten von Demenz oder Läsionen, die “emotionale Taubheit” verursachen, im Brückenbeispiel überdurchschnittlich häufig die utilitaristische Handlung5 6 7. Zudem verlangsamen kognitive Zusatzbelastungen, die das Arbeitsgedächtnis in Anspruch nehmen, utilitaristische, nicht aber deontologische Urteile8.

Studien bezüglich individueller Unterschiede scheinen die Dual-Process-Theorie ebenfalls zu stützen. Menschen, welche (1) stark “kognitionsbedürftig” sind und wenig “Vertrauen in die Intuition” haben, (2) im Cognitive Reflection Test gute Ergebnisse erzielen, oder (3) ein aussergewöhnlich leistungsfähiges Arbeitsgedächtnis haben, entscheiden sich alle öfter utilitaristisch9 10 11. Dies führt uns zu Joshua Greenes kühner Behauptung:

[…] deontologische Entscheidungen sind tendenziell durch emotionale Reaktionen motiviert, und […] die deontologische Philosophie, anstatt auf moralischen Argumenten zu basieren, ist weitgehend eine Übung in moralischer Rationalisierung. Dies steht im Gegensatz zum Konsequentialismus, welcher […] aus ziemlich unterschiedlichen psychologischen Prozessen hervorgeht, die eher “kognitiv” sind und häufiger eine genuin moralische Argumentation beinhalten.12

[Psychologisch betrachtet] ist die deontologische Moralphilosophie in Wirklichkeit […] ein Versuch, rationale Rechtfertigungen für emotional motivierte moralische Urteile zu generieren. Sie versucht nicht, moralische Schlussfolgerungen auf Basis moralischer Argumente zu erzielen.

Kognition und Emotion

Greene erklärt die Unterschiede zwischen “kognitiven” und “emotionalen” Prozessen im Gehirn wie folgt:

[…] “kognitive” Prozesse spielen eine besonders wichtige Rolle für das logische Denken, Planen, die Informationsverarbeitung im Arbeitsgedächtnis, die Impulskontrolle oder allgemein für die “höheren, exekutiven Funktionen”. Diese Funktionen tendieren zudem dazu, mit bestimmten Gehirnarealen in Verbindung zu stehen, hauptsächlich dem dorsolateralen Präfrontalkortex und dem Scheitellappen […] Emotionen hingegen hängen mit anderen Hirnbereichen zusammen, wie etwa der Amygdala und den mittleren Oberflächen des Frontal- und Scheitellappens […] Und während sich der Begriff “Emotion” auf stabile Zustände wie zum Beispiel Gemütszustände beziehen kann, werden wir uns hier hauptsächlich mit Emotionen beschäftigen, […] , welche durch Prozesse hervorgerufen werden, die […] schnell und automatisch, aber nicht zwingend bewusst sind.

Da wir es mit zwei Arten von moralischen Urteilen (deontologische und konsequentialistische) und zwei Arten von neurologischen Prozessen (kognitiv und emotional) zu tun haben, gibt es laut Greene vier empirische Möglichkeiten:

Erstens wäre es möglich, dass beide Urteilsarten generell “kognitiv” sind, wie es Kohlbergs Theorie vorschlägt (Kohlberg, 1971). Im Gegensatz dazu könnte es sein, dass beide Urteilsarten hauptsächlich emotional sind, wie es Haidt behauptet (Haidt, 2001). Dann gibt es das historische Stereotyp, dem zufolge der Konsequentialismus eher emotional ist (ausgehend von der “sentimentalistischen” Tradition David Humes (1740) und Adam Smiths (1759)) während die Deontologie eher ‘kognitiv’ ist (u.a. nach der kantische “rationalistischen” Tradition: siehe Kant (1785)). Schliesslich gibt es die Position, für welche ich eintrete, nämlich dass die Deontologie eher emotional motiviert ist, während der Konsequentialismus eher “kognitiv” ist.

Die neurowissenschaftlichen Belege, die Greene für seine Position anführt, wurden bereits erläutert. Wenden wir uns nun den Argumenten von Johnathan Haidt zu.

Emotionen und deontologische Urteile

Haidt et. al. (1993)13 legten ProbandInnen eine Reihe harmloser Handlungen folgender Art vor:

- Ein Sohn verspricht seiner sterbenden Mutter, dass er ihr Grab jeden Tag besuchen wird, nachdem sie gestorben ist, hält sich dann jedoch nicht daran, weil er zu beschäftigt ist.

- Eine Frau benutzt eine alte amerikanische Fahne, um das Badezimmer zu putzen.

- Eine Familie isst ihren Hund, nachdem er von einem Auto überfahren wurde.

- Bruder und Schwester küssen sich auf die Lippen.

- Ein Mann masturbiert mithilfe eines toten Huhns, bevor er es zubereitet und isst.

Den ProbandInnen wurden dann zu jeder dieser Handlungen Fragen wie diese gestellt: Ist diese Handlung falsch? Warum? Wird jemand geschädigt? Würde es dich stören, wenn das jemand machen würde? Greene fasst die Ergebnisse zusammen:

Was veranlasst Menschen zu sagen, dass solche Handlungen falsch sind? Eine Hypothese wäre, dass diese Handlungen als schädlich aufgefasst werden, unabhängig davon ob sie es wirklich sind […] Küssende Geschwister könnten sich selbst psychisch schädigen. Mit einem Huhn zu masturbieren, könnte Krankheiten verbreiten, etc. Wenn diese Hypothese stimmt, dann würden wir erwarten, dass die Antworten auf die Frage “Kommt jemand durch diese Handlung zu Schaden?” mit dem Grad ihrer moralischen Verurteilung korrelieren […] Alternativ, d.h. falls die moralische Missbilligung in diesen Fällen emotional motiviert ist, dann würden wir erwarten, dass die Antwort der Leute auf die Frage “Wenn du so etwas sehen würdest, würde es dich stören?” ihre Antwort auf die gestellten moralischen Fragen besser vorhersagt.

Aufmerksame LeserInnen mag es nun nicht überraschen, dass Emotionen der Grund für die deontologische Verurteilung harmloser Handlungen zu sein schienen. Darüber hinaus korrelierten sowohl Erziehung als auch Alter mit einer Zunahme an konsequentialistischen Urteilen (kognitive Kontrolle über Basisemotionen entwickelt sich erst im Laufe des Jugendalters14 15 16). Greene meint dazu:

Nach unserem Modell der moralischen Urteilsfindung, dem zufolge intuitive emotionale Reaktionen vorherrschende moralische Intuitionen anregen, die durch “kognitive” Kontrollprozesse manchmal gehemmt werden, machen diese Ergebnisse Sinn.

Es lässt sich aber noch mehr Evidenz für den Zusammenhang zwischen Emotionen und deontologischer Missbilligung unschädlicher Handlungen finden.

Wheatley & Haidt (2005)16 gaben hypnotisierbaren ProbandInnen die Anweisung, auf das Wort “often” angewidert zu reagieren, während eine zweite Gruppe hypnotisiert wurde, auf das Wort “take” angewidert zu reagieren. Anschliessend zeigten sie den TeilnehmerInnen eine Vielzahl von Szenarien, von denen einige keine Schädigung beinhalteten. (Zum Beispiel: “Two second cousins have a relationshipt in which they “take weekend trips to romatic hotels” / “often go on weekend trips to romatic hotels”.) Wie erwartet, beurteilten die ProbandInnen diejenigen Szenarien moralisch verwerflicher, die mit den Worten ausformuliert waren, auf die sie zuvor “geprimet” wurden, angewidert zu reagieren. Wheatley und Haidt benutzten die selbe Vorgehensweise in einem zweiten Experiment, in dem die ProbandInnen auf ein Szenario antworten sollten, in dem sich die Personen nicht einmal ansatzweise falsch verhielten: “A student “often picks” / ”tries to take up” broad topics of discussion at meetings.” Trotzdem hielten viele ProbandInnen jene Handlungen, die mit mit dem Wort ausformuliert waren, auf das sie geprimet wurde, für moralisch falsch. Als sie nach einer Begründung gefragt wurden, erfanden sie Rationalisierungen wie “Es scheint, als ob er etwas im Schilde führt” oder “Es fühlt sich einfach so seltsam und ekelhaft an” oder “Ich weiss es nicht, es ist einfach so”.

In anderen Studien haben ForscherInnen eine ekelerregende Situation realisiert, indem sie einige ProbandInnen an einem dreckigen Tisch oder in Gegenwart eines Furzsprays platzierten. Auch diesmal neigten jene ProbandInnen, welche der ekelerregenden Bedingung ausgesetzt waren, relativ zur Kontrollgruppe eher dazu, harmlose Handlungen als moralisch falsch zu bewerten18 19.

Abschliessend sollten wir berücksichtigen, dass die Dual-Process-Theorie vorhersagt, dass deontologische Urteile schneller gefällt werden als utilitaristische, da die deontologischen Entscheidungen hauptsächlich auf schnellen, unbewussten und emotionalen Prozessen beruhen, während die utilitaristischen langsame, bewusste Überlegungen erfordern. Suter & Hertwig (2011)20 legten ProbandInnen eine Vielzahl moralischer Dilemmas vor und forderten sie entweder dazu auf, ihre Urteile schnell zu fällen oder sich Zeit zu lassen, um gründlich durchzudenken. Wie erwartet führten schnellere Antworten zu mehr deontologischen Urteilen.

Ist der Utilitarismus emotionslos? ‒ Im Gegenteil!

Wie wir gesehen haben, erhöhen “kognitive”, utilitaristische Entscheidungen gegenüber emotional motivierten, deontologischen Urteilen die Wahrscheinlichkeit der Betroffenen, nicht geschädigt zu werden. (Im Brückendilemma z.B. ist die Wahrscheinlichkeit eines Betroffenen, ohne Schaden zu bleiben, 5-mal höher, wenn utilitaristisch entschieden wird.) Obwohl der Utilitarismus zu besseren Ergebnissen führt, wird gegen ihn oft eingewandt, er sei emotionslos und gefühlskalt. Sicher spielen “kognitive” Prozesse wie beispielsweise das Berechnen von Erwartungswerten und das Abwägen gegensätzlicher Interessen bei utilitaristischen Entscheidungen eine grosse Rolle. Aber gerade Emotionen sind dafür verantwortlich, dass wir Leid als etwas “Schlechtes” empfinden. Begriffe wie “Leid” und die Diskussion der Frage, wie wir handeln sollen und welche moralische Theorie vernünftiger ist, können sich manchmal abstrakt anfühlen. Emotionen erinnern uns aber daran, wie ernst Leid ist und machen uns bewusst, wie viel davon abhängt, dass wir unsere Entscheidungen so fällen, dass wir das Leid möglichst vieler empfindungsfähiger Wesen möglichst umfassend reduzieren. Zu diesem Ziel unsere Vernunft zu gebrauchen, ist nicht emotionslos, sondern im Gegenteil Ausdruck höchsten Mitgefühls mit jedem einzelnen Individuum. Und wenn die Ergebnisse der Moralpsychologie dazu beitragen, dass wir unsere Vernunft altruistisch möglichst optimal einsetzen, sind sie ethisch von grosser Bedeutung.